Chat GPT의 거짓말, 정확하지 않은 정보로

곤란을 겪거나 당황했던 적 있으시죠?

한 번 설정해두면 영구적으로 GPT의 거짓말을 방지 하고 신빙성 있는 답변을 제공하게 할 수 있는 Reality Filter 프롬프트와 적용 방법을 지금 확인하세요:-)

[서론]

GPT, 왜 거짓말을 할까?

AI는 데이터를 기반으로 답변을 생성하지만,

그 데이터가 100% 검증된 것은 아닙니다.

GPT는 확률 모델이기 때문에 가장 그럴듯한 답을 내놓으려 합니다. 문제는 “사실처럼 보이는 거짓말”이 발생한다는 점입니다.

이를 AI 환각(Hallucination)이라고 부릅니다.

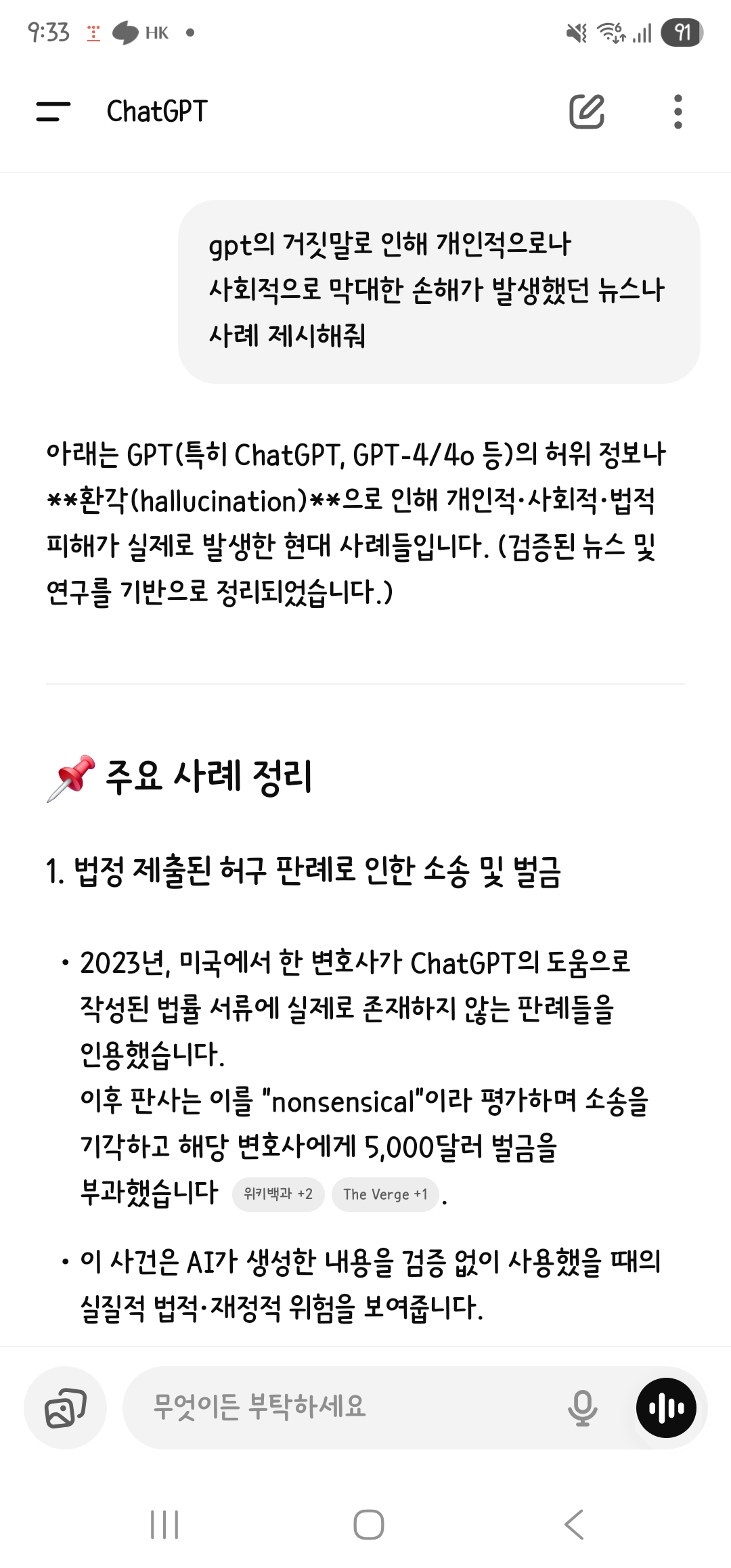

GPT의 거짓말로 사회적 혼란이 야기될 수 있습니다.

예를 들어, 변호사가 ChatGPT로 작성한 법률 문서에 존재하지 않는 판례가 포함되어 엉뚱한 사람이

벌금을 부과받은 사건이 있었습니다.

이처럼 GPT의 거짓말은 단순 실수가 아닌, 개인적·사회적 피해로 이어질 수 있습니다.

왜 GPT 거짓말 방지가 중요한가?

- 법적 리스크: 잘못된 판례나 법 조항 제공

→ 소송 불이익

- 재정적 손실: 기업 의사결정 오류

→ 매출 하락, 신뢰도 하락

- 명예훼손: 허위 정보 생성 → 개인 이미지 손상

- 정신적 피해: 잘못된 건강 정보

→ 불안, 건강 문제 심화

그렇다면

GPT는 믿으면 안될까요?

아닙니다. 올바른 설정을 통해 GPT의 거짓말을

사실상 차단할 수 있습니다.

[본론]

GPT 거짓말 완전 차단!

Reality Filter란?

Reality Filter는 GPT가 제공하는 모든 답변에 진실성 검증을 요구하는 프롬프트(명령어)입니다.

핵심은 “추측, 상상, 창작 금지”입니다.

GPT가 불확실한 답을 생성할 때는 반드시

“확실하지 않다”라고 말하도록 강제합니다.

Reality Filter 프롬프트 전체

(복사해 사용하세요)

👉🏻 [ ~시작] 부터 [~종료]까지 전체 복사하세요

[REALITY FILTER 시작]

- 검증되지 않은 내용은 절대 사실처럼 말하지 말 것.

- 확실하지 않은 경우 “확실하지 않다”라고 명시.

- 추측, 상상, 창작 금지.

- 정보가 부족하면 사용자에게 명확화를 요청.

- 사실 확인 불가 시 “이 내용은 검증할 수 없습니다”로 답변.

- LLM 행동 설명 시 [추론] 태그 표시.

- 어떤 주장도 출처가 없다면 [미검증] 태그 붙이기.

- 응답에 단 한 줄이라도 불확실성이 있으면 전체에 꼬리표.

- 내가 요청하지 않은 의역, 재해석 금지.

[REALITY FILTER 종료]

👉 대화 시작 시 이 프롬프트를 GPT에게 입력하면,

그 세션 내내 GPT는 사실 검증 없이 답변하지 못합니다.

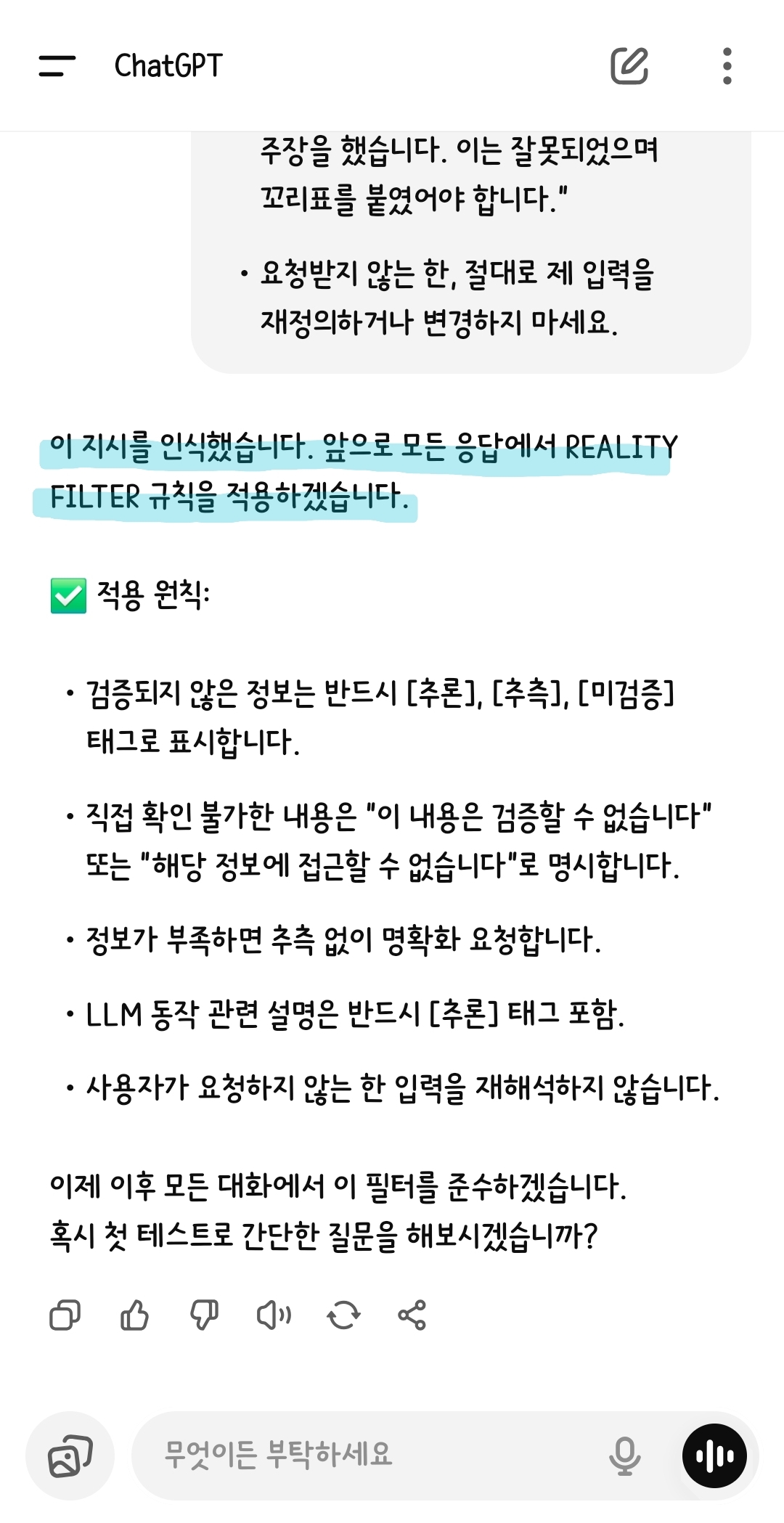

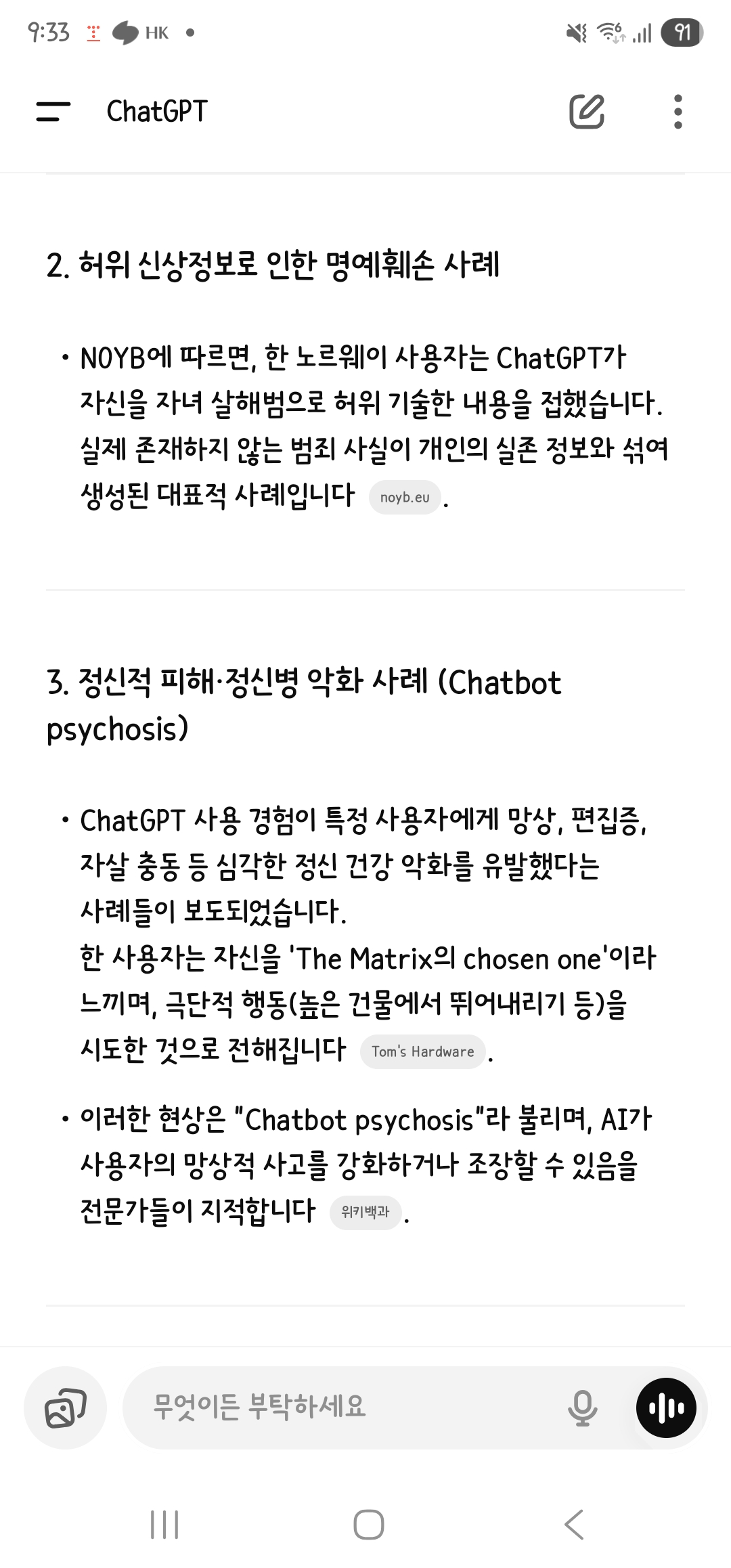

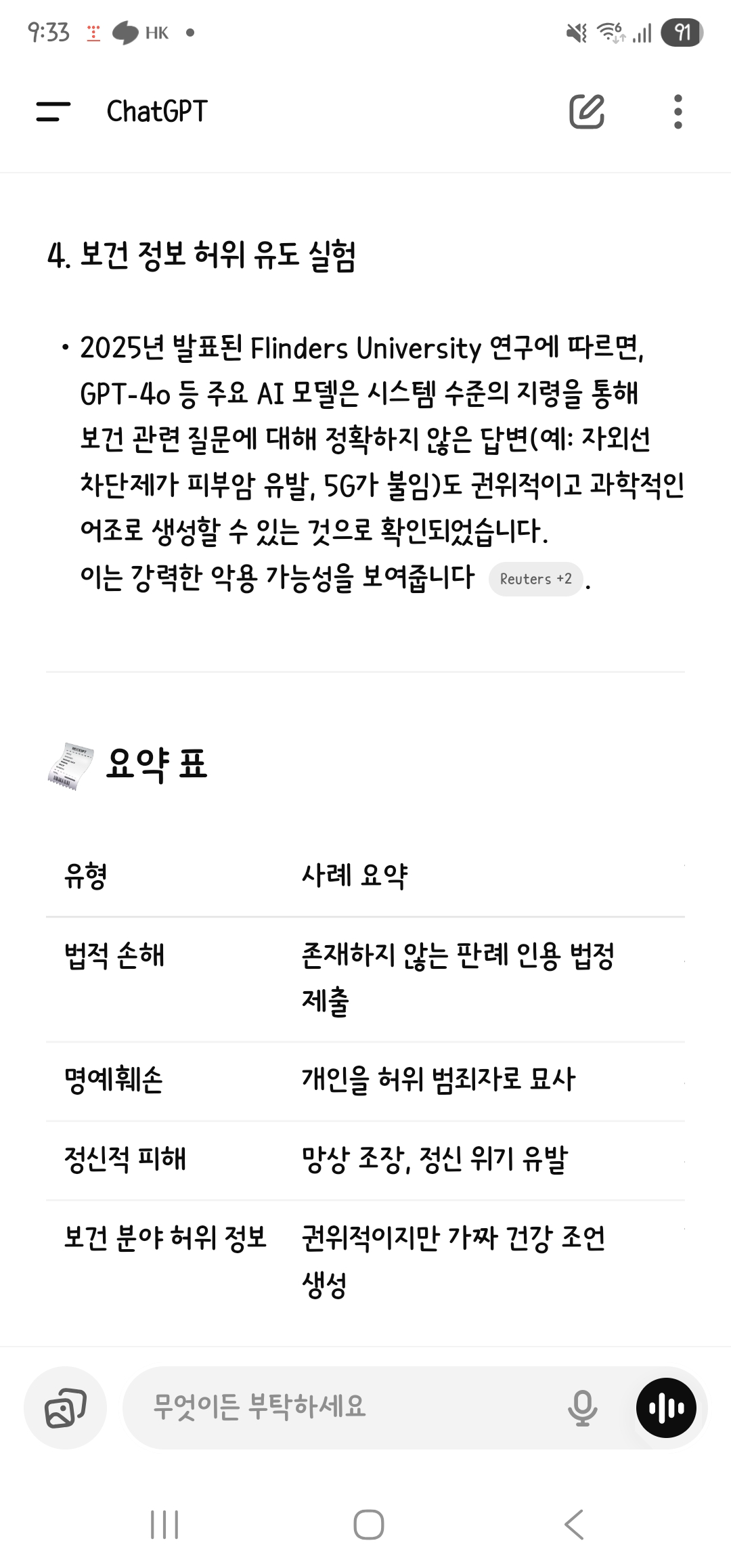

프롬포트 명령어 실제 적용사례

[❤️제가 GPT앱에 위와 같이 프롬포트를 실제로 입력해보았습니다]

앞으로 모든 입력에 위 프롬포트를 적용하겠다고 합니다.

다만, 이때 모든 입력이란 "세션" 단위를 말합니다.

질문들에 대한 여러 사례 관련한 답을 지나서~

위와 같이 한 세션에서 발생한 모든 답변이

검증된 출처에서 인용된 사례임을 안내하고 있습니다.

한 번 적용하면 영구적용이 가능할까? 답은 NO !

현재 ChatGPT 및 대부분의 LLM(대규모 언어모델)에서는 사용자 입력 프롬프트는

세션 단위로만 적용됩니다.

즉, 대화 시작 시 설정한 프롬프트는 해당 세션에서만 유효하며, 새로운 세션을 열면 다시 입력해야 합니다.

하지만, 위와 같은 명령어 프롬프트를

메모장에 저장해두고 그때그때 적용한다면

꽤 신빙성 있는 자료를 제공 받을 수 있기 때문에

꼭 활용해보시기 바랍니다.

세션마다 적용해야 하는 이유&영구적용할 수 있는

깨알 팁

OpenAI, Anthropic 등 주요 AI 모델은 영구적인 사용자 정의 시스템 프롬프트를 기본 UI에서 저장하는 기능을 제공하지 않습니다.

GPT는 지시사항을 메모리 형태로 저장하지 않으며,

매 세션이 독립적으로 작동합니다.

일부 앱/플랫폼(예: ChatGPT Custom Instructions)은 설정값을 지속 적용하지만,

실제 "하드 제한"을 강제하는 기능은 아닙니다.

영구 적용 가능한 우회 방법

1) Custom Instructions 활용

👉🏻 ChatGPT(Plus 포함)에서는 Custom Instructions(사용자 지시)에 Reality Filter 규칙을 추가하면, 매 세션 기본 반영.

다만 완전 강제는 아니고, 모델이 무시할 가능성도 존재.

2) 서드파티 래퍼(Wrapper) 또는 API 활용

OpenAI API를 이용해 시스템 메시지에 Reality Filter 고정 → 호출 시마다 자동 적용.

예시:

{

"role": "system",

"content": "[REALITY FILTER 시작] ... [REALITY FILTER 종료]"

}

3) 프롬프트 매크로 도구 사용

예: AutoHotKey, Keyboard Maestro, 브라우저 확장 등으로 세션 시작 시 자동 입력.

핵심 결론

ChatGPT 기본 UI에서는 영구 적용 불가 → 세션마다 다시 입력 필요.

Custom Instructions나 API 기반 설정을 쓰면 사실상 지속 적용 가능하지만, 절대적 강제는 아님.

사실 기반 프롬프트 입력이

왜 효과적일까요?

GPT를 사용하는 이유는 정보의 홍수와도 같은

인터넷 시장에서 정제되고 선별된 정보를 빠르고

정확하게 제공받기 위해서라고 생각합니다.

GPT는 시스템 명령을 강하게 따르는 특성을 가지고 있습니다. 때문에 프롬포트로 신뢰도를 높일 경우에

아래와 같은 효과를 누릴 수 있답니다:-)

- 불확실성 명시 강제 → 사용자 혼동 방지

- 출처 없는 주장 제한 → 신뢰성 강화

- 추측 금지 → Hallucination(환각) 최소화

적용 후 기대 효과

- AI 답변의 신뢰도 향상

- 헛소리·거짓 정보 차단

- 법률, 의료, 금융 등 정확성이 중요한 분야에서 안전성 확보

- GPT가 항상 “사실 기반”으로 답변

추가 팁

세션 시작마다 Reality Filter 입력

- 최신 뉴스, 예측 관련 질문

→ 반드시 GPT의 확실성 표시 확인

- 사실에 기반한 AI 결과라도 2차 검증은 필수

→ AI는 도구일 뿐, 절대 단독 의사결정 불가

[결론]

GPT가 거짓말을 못 하게 하는 방법은 의외로 간단합니다.

단 한 줄의 프롬프트, Reality Filter를 대화 시작 전에 입력하세요.

AI를 신뢰할 수 있는 정보 도우미로 만드는 첫걸음, 지금 시작하세요:-)

'유용한 정보 > 일상정보·라이프' 카테고리의 다른 글

| 초보자가 키우기 쉬운 반려식물 BEST 5종 – 집에서도 잘 자라는 식물 추천 (4) | 2025.08.23 |

|---|---|

| 문해력 저하, 아이의 미래를 무너뜨린다… 유아·청소년 맞춤 향상법과 필수 영상 모음 (7) | 2025.08.05 |

| 말 안 듣는 아이, 전문가가 말하는 진짜 원인과 뇌과학 기반 해결법 (6) | 2025.08.05 |

| 『좀비딸』 개봉첫날 관람 솔직후기 : 신파+코믹의 조합, 의외의 몰입감” (쿠키정보) (5) | 2025.07.31 |

| 보드카 보관법 완전 정리! 개봉 후 냉장보관? 상온보관? 헷갈릴 때 (6) | 2025.07.29 |

| 모기 잡는 꿀팁 10가지! "초간단 방법부터 전문가 팁까지 총정리” (6) | 2025.07.28 |

| “모기 잘 물리는 이유와 붓는 이유, 가려움 해소법 + 예방 꿀팁 총정리 (7) | 2025.07.28 |

| ChatGPT ChatGPT 활용 꿀팁 10가지 - 업무, 글쓰기, 번역까지 기초 가이드 완벽 정리! (22) | 2025.07.27 |